基于Apache Hudi在Google云构建数据湖平台的思路详解

自从计算机出现以来,我们一直在尝试寻找计算机存储一些信息的方法,存储在计算机上的信息(也称为数据)有多种形式,数据变得如此重要,以至于信息现在已成为触手可及的商品。多年来数据以多种方式存储在计算机中,包括数据库、blob存储和其他方法,为了进行有效的业务分析,必须对现代应用程序创建的数据进行处理和分析,并且产生的数据量非常巨大!有效地存储数PB数据并拥有必要的工具来查询它以便使用它至关重要,只有这样对该数据的分析才能产生有意义的结果。

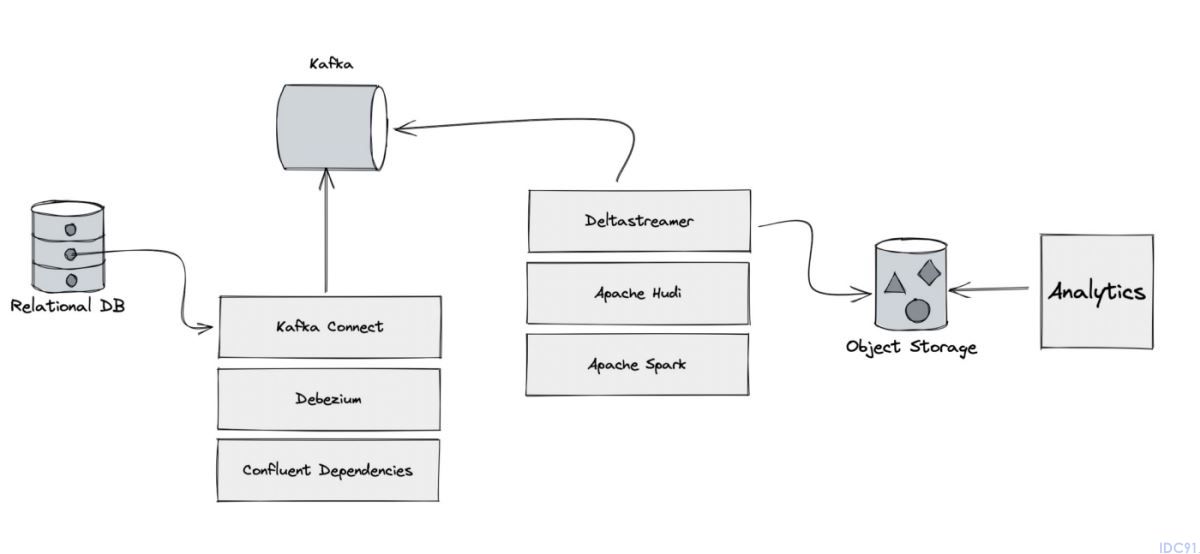

大数据是一门处理分析方法、有条不紊地从中提取信息或以其他方式处理对于典型数据处理应用程序软件而言过于庞大或复杂的数据量的方法的学科。为了处理现代应用程序产生的数据,大数据的应用是非常必要的,考虑到这一点,本博客旨在提供一个关于如何创建数据湖的小教程,该数据湖从应用程序的数据库中读取任何更改并将其写入数据湖中的相关位置,我们将为此使用的工具如下:

- Debezium

- MySQL

- Apache Kafka

- Apache Hudi

- Apache Spark

我们将要构建的数据湖架构如下:

第一步是使用 Debezium 读取关系数据库中发生的所有更改,并将所有更改推送到 Kafka 集群。

Debezium 是一个用于变更数据捕获的开源分布式平台,Debezium 可以指向任何关系数据库,并且它可以开始实时捕获任何数据更改,它非常快速且实用,由红帽维护。

首先,我们将使用 docker-compose 在我们的机器上设置 Debezium、MySQL 和 Kafka,您也可以使用这些的独立安装,我们将使用 Debezium 提供给我们的 mysql 镜像,因为其中已经包含数据,在任何生产环境中都可以使用适当的 Kafka、MySQL 和 Debezium 集群,docker compose 文件如下:

version: '2'

services:

zookeeper:

image: debezium/zookeeper:${DEBEZIUM_VERSION}

ports:

- 2181:2181

- 2888:2888

- 3888:3888

kafka:

image: debezium/kafka:${DEBEZIUM_VERSION}

ports:

- 9092:9092

links:

- zookeeper

environment:

- ZOOKEEPER_CONNECT=zookeeper:2181

mysql:

image: debezium/example-mysql:${DEBEZIUM_VERSION}

ports:

- 3307:3306

environment:

- MYSQL_ROOT_PASSWORD=${MYSQL_ROOT_PASS}

- MYSQL_USER=${MYSQL_USER}

- MYSQL_PASSWORD=${MYSQL_USER_PASS}

schema-registry:

image: confluentinc/cp-schema-registry

ports:

- 8181:8181

- 8081:8081

environment:

- SCHEMA_REGISTRY_KAFKASTORE_BOOTSTRAP_SERVERS=kafka:9092

- SCHEMA_REGISTRY_KAFKASTORE_CONNECTION_URL=zookeeper:2181

- SCHEMA_REGISTRY_HOST_NAME=schema-registry

- SCHEMA_REGISTRY_LISTENERS=http://schema-registry:8081

links:

- zookeeper

connect:

image: debezium/connect:${DEBEZIUM_VERSION}

ports:

- 8083:8083

links:

- kafka

- mysql

- schema-registry

environment:

- BOOTSTRAP_SERVERS=kafka:9092

- GROUP_ID=1

- CONFIG_STORAGE_TOPIC=my_connect_configs

- OFFSET_STORAGE_TOPIC=my_connect_offsets

- STATUS_STORAGE_TOPIC=my_connect_statuses

- KEY_CONVERTER=io.confluent.connect.avro.AvroConverter

- VALUE_CONVERTER=io.confluent.connect.avro.AvroConverter

- INTERNAL_KEY_CONVERTER=org.apache.kafka.connect.json.JsonConverter

- INTERNAL_VALUE_CONVERTER=org.apache.kafka.connect.json.JsonConverter

- CONNECT_KEY_CONVERTER_SCHEMA_REGISTRY_URL=http://schema-registry:8081

- CONNECT_VALUE_CONVERTER_SCHEMA_REGISTRY_URL=http://schema-registry:8081

上一篇:Linux、ubuntu系统下查看显卡型号、显卡信息详解

栏 目:Linux

本文标题:基于Apache Hudi在Google云构建数据湖平台的思路详解

本文地址:https://www.idc91.com/fuwuqizl/4703.html

您可能感兴趣的文章

- 10-28Linux线程之线程的创建、属性、回收、退出、取消方式

- 10-28Linux下进程的CPU配置与线程绑定过程

- 10-28Linux进程CPU绑定优化与实践过程

- 10-28linux服务器查看进程、线程数量方式

- 10-28Linux下如何清理系统缓存并释放内存

- 10-28Linux如何解决kill进程失败问题

- 10-28CentOS系统下前后端项目部署的操作指南

- 10-28Linux gdb多进程、多线程调试过程

- 10-28Apache HTTP Server 从安装到配置过程详解

- 10-28Ubuntu 24.04启用root图形登录的操作流程

阅读排行

推荐教程

- 05-27Linux NFS服务器安装与配置思路分析

- 05-27阿里云linux服务器安全设置(防火墙策略等)

- 05-27Linux命令学习总结之rmdir命令

- 10-12Linux系统 Centos7.4手动在线升级到Centos7.7

- 05-27SecureCRT中文显示乱码问题的解决方法

- 11-07Linux搭建DHCP服务器的详细过程

- 05-10Ubuntu系统安装ANSYS2021R1

- 06-12linux系统SSL证书部署https单/多站点

- 05-10ANSYS2021R1安装方法Linux centos Ubuntu系统

- 05-27apache密码生成工具htpasswd使用详解